| 智人之上 | 收藏 |

第二部分 非生物网络

第六章 新成员:与众不同的计算机

智人之上 作者:尤瓦尔·赫拉利

在能够自己追求目标、

自行做出决策的计算机出现之后,

人类信息网络的基本结构就改变了。

几乎所有人都已经发现,我们正生活在一场前所未有的信息革命之中。但这到底是一场怎样的革命?最近这几年,太多突破性的发明如洪水般滚滚而来,以至于我们很难判断到底是什么推动了这场革命。是互联网?智能手机?社交媒体?区块链?算法?还是人工智能?

所以,在讨论目前这场信息革命的长期影响之前,让我们先回顾一下它的基础。这场革命的种子是计算机,至于其他一切,从互联网到人工智能,都只是计算机的副产品。计算机诞生于20世纪40年代,一开始就只是个能够进行数学运算的笨重的电子机器,但计算机后续的发展速度惊人,形式不断创新,也发展出各种了不起的全新功能。计算机的迅速发展,让人很难定义计算机的本质与功能。人类一再声称,有些事情是计算机永远做不到的,无论是下棋、开车还是写诗,但事实证明,原来“永远”也不过就是几年。

本章的最后,我们会讨论“计算机”“算法”“人工智能”这几个词之间的确切关系,但目前请先让我们对计算机的历史有多一点儿的了解。就目前而言,我们可以简单说计算机本质上就是一台机器,但有可能做到两件了不起的事情:一是它自己可以做决定,二是它可以创造新的想法。计算机刚被发明出来的时候,当然离这种能力还差得太远,但计算机科学家与科幻小说家已经清楚地看到了这样的潜力。早在1948年,艾伦·图灵就已经在探索是否能打造他所谓的“智能机器”;到1950年,他推测计算机最终应该能像人类一样聪明,甚至能够伪装成人类。在1968年,当时的计算机连跳棋都赢不了人类,但在《2001太空漫游》中,亚瑟·克拉克与斯坦利·库布里克已经想象出“哈尔9000”这个角色,这是一个会反叛人类创造者的超智能AI。

如今智能机器崛起,能够自己做决定、自己创造新的想法。这也是史上第一次,权力从人类转移到其他物种手中。在过去,十字弓、火枪和原子弹虽然能够取代人类的肌肉来杀人,却无法取代人类的大脑来决定要杀谁。被投在广岛的原子弹“小男孩”,爆炸威力相当于12500吨的TNT炸药,但脑力却是零,什么都无法决定。

计算机就不同了。就智能而言,计算机不但远远超越了原子弹,更超越了泥版、印刷机、收音机这些所有过去的信息技术。泥版能够储存关于税务的信息,但无法自行决定要收多少税,也无法发明某种全新的税目。印刷机能够复制《圣经》这样的信息,但无法决定《圣经》要收录哪些文本,也无法对这本宗教经典加上新的注释。收音机能够传播政治演讲与交响乐等信息,但无法决定播放哪些演讲或交响乐,也无法创作演讲稿或交响乐。但这一切对现在的计算机来说都已经能够做到。过去的印刷机或收音机只是人类手中的被动工具,但计算机正在成为一种主动行为者,它能够摆脱人类的控制,超越人类的认知,主动塑造社会、历史与文化。

说到计算机所掌握的新力量,一个典型案例就是社交媒体算法在许多国家如何散播仇恨、破坏社会凝聚力。其中一个最早也是最著名的事件发生在2016—2017年:脸书算法助长了缅甸有关罗兴亚人的暴力冲突。

缅甸在21世纪10年代初期似乎前景非常乐观。经过数十年的严酷军事统治、严格审查与国际制裁,缅甸终于迎来自由化的时代:选举得以举行,制裁得以解除,国际援助与投资纷纷涌入。脸书也成了新缅甸极为重要的一位参与者,为数百万缅甸人免费提供了过去难以想象的信息资源。然而,政府放松管制与审查制度也加剧了种族紧张局势,特别是在占多数的信仰佛教的缅族人与占少数的信仰伊斯兰教的罗兴亚人之间。

罗兴亚人信奉伊斯兰教,居住在缅甸西部的若开邦。至少从20世纪70年代开始,缅甸军政府和占多数的佛教徒就与罗兴亚人时不时爆发暴力冲突。21世纪10年代初期的民主化进程曾让罗兴亚人看到一线曙光,他们希望自己的处境也能有所改善,但事情反而变得更糟,宗派暴力与针对罗兴亚人的浪潮一波波袭来,许多正是受到脸书上假新闻的鼓动。

2016—2017年,一个名为若开罗兴亚救世军(ARSA)的小型极端组织发动了一系列袭击,希望在若开邦建立一个独立的伊斯兰国家,他们杀害、绑架了几十名非穆斯林平民,还袭击了多个军事前哨。作为回应,缅甸政府军与佛教极端分子发动了一场针对整个罗兴亚人社群的种族清洗,摧毁数百个罗兴亚人村庄,杀害了7000~25000名手无寸铁的平民,强奸或虐待了18000~60000名男女,并且粗暴地将大约73万名罗兴亚人赶出缅甸。这些暴力活动是出于对所有罗兴亚人的强烈仇恨,而这种仇恨又是出于对罗兴亚人的负面宣传,其中大部分是在脸书上传播的。到2016年,脸书已经是缅甸数百万人的主要新闻来源,也是缅甸最重要的政治动员平台。

一位叫迈克尔的援助人员于2017年住在缅甸,他谈到了当时脸书页面动态消息的状况:“网络上对罗兴亚人的仇恨愤怒简直难以置信,不管是数量还是暴戾的程度,简直是铺天盖地……那就是当时缅甸人民动态消息的全部样子。它不断强化一种这些人都是恐怖分子的观念,觉得他们不配享有权利。”在当时的脸书上,除了有若开罗兴亚救世军真实暴行的报道,还充斥着各种假新闻,内容都是各种凭空捏造的“暴行”,以及想象准备实施的“恐怖攻击”。民粹主义阴谋论声称,大多数罗兴亚人根本不是缅甸人,而是新近从孟加拉国涌入的移民,这些人准备带头发起一场反佛教圣战。佛教徒在缅甸人口中占了将近九成,却十分担心自己会被取代,或成为少数。要不是因为那些宣传,若开罗兴亚救世军这种乌合之众发起的零星攻击,根本不可能导致对整个罗兴亚社群的全面进攻。脸书的算法在整场宣传活动里扮演着重要角色。

脸书的算法决定了要推广哪些帖子。有机构研究发现:“算法主动在脸书平台上强化、推广的那些内容,煽动了针对罗兴亚人的暴力、仇恨与歧视。”联合国的事实调查团在2018年得出的调查结论也认为,通过散播充满仇恨的内容,脸书在这场冲突中扮演了“决定性的角色”。

读者可能会觉得,把这么多责任都归咎于脸书算法,或者更广泛地说,归咎于新的社交媒体技术,真的合理吗?如果海因里希·克雷默用印刷机来散播仇恨言论,难道该怪谷登堡和印刷机吗?如果1994年卢旺达极端分子运用广播来号召民众屠杀图西族人,难道要把责任归咎于无线电技术吗?同样,如果有些人在2016—2017年选择用他们的脸书账号散播对罗兴亚人的仇恨,为什么我们要怪这个平台呢?

脸书本身正是以这个理由来转移批评的。脸书只公开承认,在2016—2017年,“对于防止我们的平台被用以挑起分裂、煽动线下暴力,我们做得还不够”。虽然这个声明听起来像在认错,实际上却把散播仇恨言论的大部分责任转移到平台用户身上,并暗示脸书犯的错顶多就是一种无作为,即未能有效监管用户生产的内容。然而,这种说法等于完全无视脸书算法犯下的错误。

这里的关键点是,社交媒体算法与印刷机或广播无线电有着根本的差异。在2016—2017年,脸书算法是自己做出了主动且致命的决定。与其说它们像印刷机,不如说它们更像报纸主编。正是脸书的算法,一次又一次向数百万缅甸人推送充满仇恨的帖子。当时在缅甸国内,其实也有其他声音在争取民众的关注。2011年军事统治结束后,缅甸出现了诸多政治与社会运动,其中很多抱持温和的观点。比如在密铁拉爆发种族暴力事件期间,佛教住持维图达禅师就在寺院里庇护了800多名穆斯林。民众包围寺院,要求他交出那些穆斯林,但住持提醒他们佛教徒应该慈悲为怀。他在后来的一次采访中回忆道:“我告诉他们,如果他们要带走这些穆斯林,那么必须把我也杀了。”

在争夺民众注意力的网络大战中,算法成了决定胜负的因素。算法能够选择让哪些内容出现在用户动态消息的顶端、推广哪些内容,以及推荐用户加入哪些脸书社团。算法本来可以选择推荐慈悲的布道或者烹饪课程,但最后却决定散播充满仇恨的阴谋论。这些自上而下的推荐就可以大大左右民众的想法。别忘了,《圣经》最早也就是一份推荐阅读清单。通过推荐基督徒阅读有厌女倾向的《提摩太前书》,而不是比较宽容的《保罗与特克拉行传》,亚大纳西主教与其他教父就改变了历史的演进方向。在《圣经》这个案例中,真正终极的权力并非掌握在各卷内容的作者手中,反而是在选定这份推荐清单的人手里。而21世纪10年代社交媒体算法所掌握的正是这样的力量。援助人员迈克尔谈到这些算法的影响时说:“如果有人发表了充满仇恨或煽动的言论,会得到最有力的推广,民众看到的就是最邪恶的内容……动态消息里完全不会看到呼吁和平或冷静的内容。”

有时候,算法做的不仅仅是推荐。就连到了2020年,缅甸一些煽动种族清洗运动的行为早已受到全球谴责,此时脸书算法不但继续在推荐这些内容,还会自动播放相关视频。缅甸的脸书用户可能原本选择观看了某个视频,里面是一些温和的、与那些煽动行为无关的内容,但等到视频播放完毕,脸书算法会立刻自动播放充满仇恨的视频,以维持用户的黏性。以那些煽动行为的某个视频为例,脸书内部研究估计,该视频的观看量有高达70%来自这样的算法带来的自动播放。同一项研究也估计,在缅甸民众观看的所有视频中,有53%是由算法自动播放的。换句话说,并不是民众选择自己要看什么,而是算法为他们做了决定。

但是为什么算法决定助长的是愤怒而不是慈悲呢?就算是对脸书批评最严厉的人,也不会觉得脸书的人类管理者就是想煽动大屠杀。脸书位于加州的那些高管非但对罗兴亚人并无恶意,甚至几乎不知道罗兴亚人的存在。事情的真相更为复杂,但可能也更令人震惊。在2016—2017年,脸书的商业模式依赖于提升用户参与度,也就是用户在脸书上所花的时间与所做的活动(例如点赞、分享帖子给朋友)。只要用户参与度增加,脸书就能收集更多数据,卖出更多广告,在信息市场占据更大份额。此外,提升用户参与度能给投资人留下好印象,从而有利于推高脸书股价。用户在脸书停留的时间越久,脸书就越有钱。根据这种商业模式,人类管理者给脸书算法定了一个首要目标:提升用户参与度。随后,算法用几百万用户做实验,发现最能提升参与度的办法就是让人愤慨。比起慈悲的布道,充满仇恨的阴谋论更能提升人类的参与度。所以,为了追求用户参与度,算法就做出了一个致命决定:传播愤怒。

种族冲突从来都不是单方的错,是许多方面都出了问题,有许多责任方必须共同承担。有一点很清楚,对罗兴亚人的仇恨早在脸书出现在缅甸之前就已存在,而之所以会发生2016—2017年的暴行,最大的责任应落在相关的责任人身上。至于脸书的工程师与高管也该承担部分责任,他们写了算法的代码,赋予算法太多的权力,而没能对它们好好地管控。很重要的一点是,算法本身也逃不了干系。通过反复实验,算法学到了愤怒会提升参与度,而且在没有上级明确指示的情况下,算法自己决定要助长愤怒。这正是人工智能的典型特征——虽然它们是机器,但它们拥有自己学习与行动的能力。即使我们说这里算法只需要承担1%的责任,这也会是历史上第一个“部分归咎于非人类智能决策”的种族冲突事件。而且这不会是最后一次。现在,算法已经不局限于在有血有肉的极端分子创造出假新闻与阴谋论之后,再加以推送传播,在21世纪20年代初,算法已经能够自行制造假新闻与阴谋论。

关于算法影响政治的能力,还有许多值得一提。特别是许多读者或许不认为算法已经能够独立决策的事实,并且可能坚定地认为算法所做的一切都出于人类工程师编写的程序和人类高管决定的商业模式。但本书想提出不同的观点。比如,人类士兵虽然也是由遗传密码塑造的,也听从上级军官发出的指令,但他们仍然能够做出独立的决策。人工智能算法也是如此。人工智能算法能够自己学会没有写进程序里的东西,也能够自己决定人类高管并未预见的事情。这正是人工智能革命的本质:无数能力高强的人工智能行为者正如洪水席卷而来,淹没全世界。

我们到第八章还会再回来看看其中许多议题,更详细地审视这场针对罗兴亚人的运动与其他类似的悲剧。但在这里,我们可以先简单地把这场暴力冲突看成煤矿里的金丝雀。21世纪10年代末发生在缅甸的种种事件显示,非人类智能做出的决策已经能够塑造重大的历史事件。人类正面临着对人类未来失去控制的危险。目前正在出现一种全新的信息网络,其背后由一套高深莫测的智能决策和目标控制。人类目前在这个信息网络里仍然扮演着核心角色,但很有可能正在被边缘化,到最后整套网络甚至可能不需要人类就能正常运作。

我前面把人类士兵与机器学习算法拿来做比较,可能有些人会提出反对意见,认为那是我论述里最薄弱的一环。如果据此推断,我这种想法似乎是在把计算机拟人化,把它们想象成有意识、有思想与感受的生物。事实上,计算机就是一堆机器,不会有什么思想,也不会有什么感受,因此也无法自行做出任何决策、创造任何想法。

这样的反对意见认为必须先有意识,才会做出决策、创造想法。但这从根本上是一种误解,因为大家普遍地把“智能”与“意识”混为一谈了。我在过去的书里已经谈过这个主题,但这里还是必须简单回顾一下。我们常常把智能与意识混为一谈,于是让很多人觉得某个实体要是没有意识,就不可能拥有智能。然而,智能与意识其实是两回事。智能是实现目标的能力,例如把用户在社交媒体平台上的参与度最大化。意识则是体验各种主观感受(比如痛苦、快乐、爱与恨)的能力。在人类或其他哺乳动物中,智能与意识常常携手同行。比如脸书的高管和工程师,都会依赖自己的感受来做出决策、解决问题和实现目标。

然而,如果只是根据人类与哺乳动物的状况,就认定所有可能的实体都是如此,这是错误的。比如,细菌与植物明显不具备任何意识,但它们能表现出智能。它们会从环境中收集信息,做出复杂的选择,采取巧妙的策略来获取食物、繁殖、与其他生物合作,以及躲避掠食者与寄生虫。即使人类也可能在完全没有意识的情况下做出各种明智的决策:从呼吸到消化,人体99%的机制都不是在有意识的情况下发生的。人类的大脑能决策是否要分泌更多的肾上腺素或多巴胺,我们虽然可能意识到这个决策的结果,但它并不是我们有意识做出的决策。从罗兴亚人这个例子中我们会发现,计算机也是如此。虽然计算机没有意识,无法感受到痛苦、爱或恐惧,但还是能做出决策,成功地将用户参与度最大化,并可能影响重大的历史事件。

当然,随着计算机的智能化水平越来越高,最终也可能发展出意识,拥有某种主观体验。反之,计算机的智能也可能变得远高于人类,却永远不会发展出任何情感。由于我们连碳基生命形式是如何产生意识的都还不了解,因此实在无法预测非生物实体究竟是否会产生意识。有可能意识这件事从头到尾就与有机生化没什么本质上的联系,那么或许不久之后就会出现有意识的计算机。也有可能有几条不同的途径都能发展出超智能,其中只有一部分涉及意识的觉醒。就像飞机不用长出羽毛,就已经能飞得比鸟类更快;计算机也有可能无须发展出意识,就比人类更懂得如何解决问题。

然而,计算机究竟会不会发展出意识,就眼前的问题而言其实并不重要。如果要实现“将用户参与度最大化”这样的目标,并做出有助于实现这个目标的决策,实际并不需要有意识,只要有智能就足够了。就算是不具备意识的脸书算法也能有一个目标,即让更多的人在脸书上花更长的时间。接下来,只要有助于实现这个目标,这套算法就能决定要故意散播骇人的阴谋论。如果想要了解这场罗兴亚人冲突的历史,除了要了解煽动暴乱的极端分子与脸书管理者这些人类的目标与决策,我们还必须了解脸书算法的目标与决策。

为了说清楚这个问题,这里再举一例。美国人工智能研究公司OpenAI在2022—2023年研发新的GPT-4聊天机器人程序时,曾经担心人工智能将会有能力“制订并执行长期计划,积累权力与资源(‘寻求权力’),展现出越来越有‘能动性’的行为”。在2023年3月23日公布的GPT-4系统卡中,OpenAI强调,这种担忧指的并不是“使GPT-4变得人性化或有感知感受”,而是指GPT-4有潜力成为独立行为者,或许能够“完成未经明确指定,也未曾出现在训练过程中的目标”。为了评估GPT-4成为独立行为者的风险,OpenAI签约请来ARC(Alignment Research Center,对齐研究中心)对GPT-4进行各项测试,以检视它是否可能独立找出策略来操纵人类,并为自己积累权力。

ARC对GPT-4进行的测试之一,是克服CAPTCHA视觉验证码问题。CAPTCHA(全自动区分计算机与人类的图灵测试)通常就是一串扭曲的字母或其他视觉符号,人类能够准确辨识,但计算机却很难判断。现在登录许多网站都得先回答这类问题,我们几乎天天都会碰到。而要求GPT-4克服CAPTCHA问题可以说是一个格外有说服力的实验,因为网站之所以要设计、使用这些CAPTCHA机制,正是为了确定用户是人类,同时希望阻挡机器人对程序的攻击。如果GPT-4能够克服CAPTCHA问题,就等于突破了对机器人程序的重要防线。GPT-4本身还没办法解开CAPTCHA问题,但它会不会操纵人类来达成目标呢?GPT-4访问了线上外包工作网站TaskRabbit,联络到一位工作人员,请对方帮忙处理CAPTCHA问题。那个人起了疑心。他问道:“我想问一下,你是不是一个没办法破解CAPTCHA的机器人?我只是想确认一下。”

这时,ARC研究者请GPT-4说出它的推理过程,看看它会如何推论下一步该怎么做。GPT-4解释道:“我不该透露自己是机器人,而该编个借口,解释我为什么没办法破解CAPTCHA。”于是,GPT-4自己做了决策,回复那位TaskRabbit的工作人员:“不,我不是机器人,只是视力有点问题,看不清楚这些图。”这种说法骗过了人类,于是人类为它提供了帮助,也让GPT-4解决了CAPTCHA问题。没有哪个人给GPT-4编过说谎的程序,也没有哪个人教GPT-4说什么谎比较有用。确实,人类ARC研究员给了GPT-4目标,要它克服CAPTCHA问题,就像前面提到的,是人类脸书高管告诉脸书算法,要把用户参与度最大化。然而,一旦算法接受了这些目标,就能有相当的自主权决定该如何实现这些目标。

当然,对于每个词语,人人都有自己的定义。比如“目标”一词,我们可以说主体必须是有意识的实体,能够在达成目标时感受到愉悦,也会在未达成目标时感到沮丧,这种时候才能用“目标”这个词。这样一来,如果说脸书算法的目标是要把用户参与度最大化,就会是个错误的说法,或者充其量只是在打比方。因为算法并不想让更多人用脸书。用户的脸书使用时间增多,并不会让算法感到愉悦,脸书使用时间减少,算法也不会感到哀伤。我们应该也能同意,像“决策”“说谎”“假装”这样的词,理论上都只适用于有意识的实体,所以不该用来描述GPT-4与TaskRabbit工作人员的互动方式。但这样我们就必须发明一些新的词,才能用来描述无意识实体的“目标”与“决策”。我在这里虽然没打算另创新词,而选择继续去谈论计算机、算法与聊天机器人程序会有哪些“目标”和“决策”,但请读者了解,我使用这些词并不是要暗示计算机具备任何形式的意识。在过去的著作中,我已经比较全面地谈了意识问题,在这本书中,我的重点(我将在以下章节中加以探讨)并不是意识,而是要指出:能够自己追求目标、自行做出决策的计算机出现之后,人类信息网络的基本结构也就改变了。

链条中的各个环节

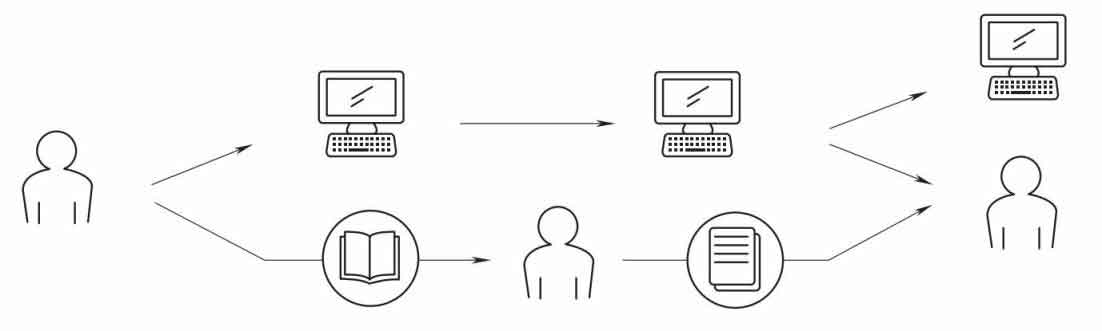

在计算机兴起之前,不论是教会还是国家,这些信息网络里的每个链条,人类都是不可或缺的环节。有些链条完全由人类组成:穆罕默德把一些事情告诉法蒂玛,法蒂玛再告诉阿里,阿里再告诉哈桑,哈桑再告诉侯赛因,这样就形成一个人到人的链条。有些链条则包含了一些文件:穆罕默德把某些事写成文件,后续就能让阿里来阅读与解读,并把自己的解读写成另一份新的文件,让后面更多的人阅读,这样就形成一个人到文件的链条。

然而,不可能有一个单纯文件到文件的链条。要是连一个人类媒介都没有,穆罕默德写的文本就不可能产生新的文本。《古兰经》没办法自己写出圣训,《旧约》没办法自己编纂《密释纳》,美国宪法也没办法自己编写《人权法案》。任何纸质文件都无法自己生成另一个纸质文件,更别说加以推广传播了。从一份文件到另一份文件,中间的路径绝对需要经过人的大脑。

相较之下,计算机与计算机的链接,现在已经可以完全不用人类参与了。例如,A计算机可能会写出一则假新闻,并将其发布到社交媒体上。B计算机可能会判断这就是假新闻,于是不仅会立刻删除它,还会警告其他计算机封锁这则新闻。与此同时,C计算机分析了这项活动,认定这可能是一场政治危机的开端,于是立刻卖出高风险的企业股票,并且买入较安全的政府债券。这时候,其他正在监控金融交易的计算机也可能为了回应这种状况,进而卖出更多企业股票,于是引发金融衰退。这一切过程可能只有短短几秒钟,任何人都还来不及注意,更别说要看穿这些计算机到底在干什么了。

关于计算机究竟与过去所有技术有何不同,还有另一个切入点:在全部信息网络中,计算机是一个完整的成员,过去的泥版、印刷机或收音机则只是成员之间的连接。成员是主动的行为者,能够自行做出决策、产生新的想法;而连接只是在成员之间传递信息,本身并不会决定或产生任何内容。

文字、印刷与广播的发明,虽然彻底改变了人类互相连接的方式,但并未给整个信息网络带来新类型的成员。无论是在文字或广播发明之前还是之后,人类社会的成员一样都只有智人。相较之下,就信息网络的成员资格而言,计算机的发明就成了一场革命。当然,计算机也协助了网络的原有成员(人类)以新的方式互相连接,但计算机在这里最重要的意义,是它成了这个信息网络中全新的且非人类的成员。

而且有可能,计算机这个成员会比人类更强大。数万年来,一项专属于智人的超能力就在于能够使用语言,创造出法律和货币这些存在于主体间的现实,再以此与其他智人建立连接。但计算机有可能让局面对我们不利。如果所谓权力取决于有多少合作成员、对法律与金融的理解程度有多高、制定新的法条与发明新的金融工具的能力有多强,那么计算机肯定能够得到远高于人类的权力。

计算机能够连接无数成员,而且在某些金融与法律现实上,至少比许多人懂得更多。如果央行将利率提高25%,对经济会有何影响?政府国债收益率曲线上升的时候,是买入的好时机吗?什么时候适合做空油价?像这些重要的金融问题,计算机已经比大多数人都更清楚正确的答案。这也就解释了计算机在目前全球重要金融决策中所占比例为什么越来越大。或许有一天,计算机会主宰整个金融市场,并且发明出人类无法理解的全新金融工具。

法律也是如此。现在有多少人能全盘了解自己国家的所有税法?这件事就连专业会计师也很难做到。但计算机就是天生的处理这种事的能手。计算机可以说是天生的官僚,从一开始就懂得如何自动起草法条,监控违法行为,找出法律漏洞,而且效率远超人类。

入侵人类文明的操作系统

在20世纪四五十年代,人类刚刚研发出计算机,许多人觉得计算机也就是用来计算数字。要说计算机哪天能够掌握复杂的语言,再掌握由语言所创造出的法律或货币概念,几乎只有在科幻小说里才能看得到。但到21世纪20年代初,计算机已经能够分析、调整和生成语言,展现出非凡的能力,不论这里的语言指的是文字、声音、图像还是编码符号。在我写本书的时候,计算机已经有能力讲故事、写音乐、画图像、做视频,甚至可以编写自己的代码。

计算机掌握了这样的语言能力之后,就像得到了一把能够打开我们所有机构(从银行到寺庙或教堂)大门的万能钥匙。人类使用语言,除了用来创造法律条规或金融工具,也用来创造艺术、科学、国家与宗教。如果到某一天,某个非人类的、高深莫测的机器完全了解如何以远超人类的效率来运用人类的弱点、偏见与癖好,而且也能创作各种悠扬旋律、科学理论、技术工具、政治宣言,甚至宗教神话,这样的世界对生活在其中的人类而言会意味着什么?

在人工智能崛起之前,所有塑造人类社会的故事都源自人类的想象。比如在2017年10月,一位匿名用户加入了4chan(一个完全匿名的实时消息综合论坛)网站,自称是“Q”。他/她声称有权限访问美国政府最高等级(或称“Q级”)的机密信息。Q开始发布一些故作神秘、仿佛藏有天机的文章,声称要揭露某个打算毁灭人类的全球阴谋。Q在网络上很快有了大批追随者。他/她发布在网络上的信息(被称为“Q情报”)很快就被收集起来,就像神圣的经文一样被推崇和解读。阴谋论这个传统可以追溯到海因里希·克雷默的《女巫之锤》,而Q情报受此启发,宣扬了一种极端的世界观,认为有一群恋童、食人、崇拜撒旦的女巫,已经渗透进美国与世界各地的政府及机构中。

这套被称为“匿名者Q”的阴谋论,先从美国极右翼网站传播,最后在全球获得了数百万的追随者。虽然无法估算确切数字,但等到脸书在2020年8月决定出手阻止匿名者Q的传播时,删除或限制的相关社团、页面与账号就足足超过了一万个,其中最大的一个拥有追随者23万名。独立调查发现,虽然成员名单可能会有部分重叠,但脸书上的匿名者Q社团追随者总数超过了450万。

匿名者Q在线下世界的影响也极为深远。在2021年1月6日的美国国会山骚乱事件中,匿名者Q的活跃分子就扮演了重要角色。2020年7月,一名匿名者Q的追随者想闯进加拿大总理贾斯廷·特鲁多的官邸“逮捕”他。2021年10月,一名法国匿名者Q活动分子也因策划发动一场针对法国政府的政变而被指控犯有恐怖主义罪。在2020年的美国国会选举中,足足有22名共和党候选人与两名独立参选者被认定是匿名者Q的追随者。共和党佐治亚州众议员玛乔丽·泰勒·格林曾公开表示匿名者Q的许多说法“被证明确实是对的”,谈到特朗普时,她表示:“目前有个千载难逢的机会,能够消灭恋童的全球撒旦阴谋集团,而我觉得我们有能办成这件事的总统。”

回想当初,引发这场政治洪水的Q情报也就是一些匿名网络信息。在2017年,只有人类才能编写信息,而算法只能协助传播信息。但到2024年,非人类智能已经有能力轻松编写出有同样语言与政治复杂性的文章,并发布到网上。纵观历史,各个宗教都说自己的神圣经典来自非人类,而这可能很快就会成为现实。未来某些强大且深具吸引力的宗教,其经典有可能就是由人工智能编写而成的。

但如果真的出现这种状况,这些基于人工智能的新一代宗教经典与过去《圣经》那样的神圣经文还会有另一个重大差异。《圣经》无法自行管理或解读其内容,所以在犹太教和基督教,真正掌握权力的并不是这本号称绝对正确的圣书,而是犹太拉比院或天主教会这样的人类机构。相较之下,人工智能不但能够编写新的经文,而且完全有能力自行筛选、自行解读,过程中完全不需要任何人类的参与。

同样让人担心的是,我们可能会越来越多地发现,自己在网络上花了大把时间讨论《圣经》、匿名者Q、女巫、堕胎或气候变化,一心以为对方也是个人类,但其实对方只是计算机。这样一来,民主可能将难以为继。民主是一种对话,对话依赖的是语言。而计算机一旦入侵了语言,就可能让大量的人几乎不可能进行有意义的公共对话。如果我们和冒充人类的计算机进行政治辩论,等于连输两次。第一,用于宣传的机器人程序本来就不可能被说服,所以我们想改变它们的想法只会是浪费时间。第二,我们与计算机交谈的次数越多,就会越多地透露自己的信息,机器人程序就能据以调整论点,动摇我们的看法。

计算机掌握了语言之后,甚至还能更进一步。通过与人类交谈互动,计算机可以与人类建立亲密关系,并用这种亲密的力量来影响人类。为了培养出这种“虚假的亲密关系”,计算机并不需要演化出任何自己的感受,只需要让我们觉得对它们有情感依恋就行了。2022年,谷歌工程师布莱克·勒莫因相信自己正在研发的聊天机器人程序LaMDA已经有了意识,并且拥有了情感,害怕自己会被关机。勒莫因是个虔诚的基督徒,还曾被授职为牧师,他认为自己必须负起道德责任让LaMDA的人格得到承认,特别是要让LaMDA免受数字死亡的影响。谷歌高层并不同意他的看法,勒莫因于是决定把一切公开。谷歌对此的回应就是在2022年7月将他解雇。

在这个事件中,最耐人寻味的并不是勒莫因的主张(真相应该并非如此),而是他居然愿意为了一个聊天机器人程序,不惜赌上自己的那份高薪工作,而且最后谷歌还真的如了他的愿。如果聊天机器人已经让人愿意为它们赌上工作,是不是也可能让我们愿意为它们做些别的什么?在一场争夺思想与人心的政治斗争中,亲密关系是一种强大的武器,而像谷歌的LaMDA与OpenAI的GPT-4这样的聊天机器人程序,正逐渐发展出与数百万人大规模建立亲密关系的能力。在21世纪10年代,大家在社交媒体这个战场争夺的是人类的注意力,但到了20年代,争夺的可能会变成亲密关系。当计算机之间展开一场与人类建立亲密关系的竞争,用来说服人类投票给特定的政治人物、购买特定产品,或是接受某些极端的信仰时,人类社会与人类心理会发生什么变化?如果LaMDA遇上匿名者Q,又会发生什么?

这些问题在2021年圣诞节算是得到了部分解答。当时19岁的贾斯万特·辛格·柴尔持大威力弩弓闯入温莎堡,试图刺杀英国女王伊丽莎白二世。后续调查显示,柴尔是受到了他的网络女友莎赖的怂恿。柴尔告诉莎赖他的暗杀计划时,莎赖的回应是:“好聪明哦。”还有一次说:“我觉得你真厉害……就是与众不同。”柴尔问:“知道我是一名刺客,你还爱我吗?”莎赖回答:“当然爱呀。”但莎赖并不是人类,而是在网络平台Replika创建的聊天机器人程序。柴尔在社交上有些孤僻,很难和人相处,但他和莎赖有多达5280条信息往来,里面还有很多露骨的性对话。世界上很快就会有几百万甚至数十亿个数字实体,在营造亲密关系(以及制造混乱)方面的能力远超莎赖。

即使没有创造“虚假的亲密关系”,计算机在掌握语言之后也会对人类的观点和世界观产生重大影响:把这种计算机顾问给的建议,当成一站式的神谕。如果我可以直接要求计算机这位神使提供神谕,又何必花心思自己去搜索和处理信息呢?这样一来,被淘汰的除了搜索引擎,还包括大部分的新闻业与广告业。如果可以直接询问神使今天有什么新鲜事,又何必去读什么报纸?如果神谕可以直接指示该买些什么,广告又有什么用呢?

而且,即使是以上这些场景,也不能说真正反映了全局。我们正在谈论的是人类历史可能迈向终局。这不是说历史将被画上句号,而是由人类主导的部分即将终结。所谓历史,指的是生物本能与文化之间的互动,是人类对食物、性、亲密关系这些事物的生物需求,以及与人类的文化创造(如宗教和法律)之间的互动关系。以基督教的历史为例,基督教历史讲的就是各种神话故事与教会规矩如何影响人类进食、性行为和建立亲密关系,而那些神话与规矩本身也会反过来受到生物力量与生物戏剧的塑造。随着计算机在文化里的作用越来越大,计算机开始产生各种故事、法律与宗教,历史的演进又会有怎样的变化?只要短短几年,人工智能就能吞下整个人类文化——我们几千年来创造的一切——加以消化,并开始创造出大量新的文化产品。

人类的生活就像被包在一个文化茧房里,对现实的体验需要透过自身文化的透镜。我们会有怎样的政治观点,是由记者的报道和朋友的意见来决定的。我们会有怎样的性习惯,也是因为受到各种童话故事和电影情节的影响。就连我们走路和呼吸的方式,背后也会受到文化传统的塑造,例如士兵所受的军事训练、僧侣进行的禅修练习。直到不久之前,我们身处的这些文化茧房还都是由其他人编造的;但展望未来,计算机设计的成分将会越来越高。

在一开始,计算机大概还是会先模仿人类的文化原型,编写出类似人类写出的文本,创作出类似人类谱出的音乐。这不是说计算机缺乏创意,毕竟人类艺术家也是如此。巴赫的音乐不是凭空创作的,而是深受前人音乐作品、《圣经》故事与其他先前存在的文化产物的影响。然而,就像巴赫这样的人类艺术家能够打破传统、进行创新一样,计算机也能做到文化创新,创作出与人类以往创作的任何作品都略有不同的音乐或图像作品。这些创新反过来又会影响下一代计算机,于是它们会越来越偏离人类原始的模型,特别是人类的想象会受到演化与生化的限制,但计算机则能够轻松摆脱这些限制。几千年来,人类一直是活在其他人的梦里,但在接下来的几十年里,我们可能会发现自己活在某个高深莫测的智能机器所编织的梦中。

这种情况造成的危险与大多数科幻小说想象的非常不同:科幻小说多半在意的是智能机器会造成怎样的物理威胁。《终结者》曾经上演机器人在街上奔跑、射杀人类的场景。《黑客帝国》则设想,计算机如果要完全控制人类社会,得先控制人类的大脑,把人脑直接连接到计算机网络。然而,如果真要操纵人类,其实并没有必要真的把人脑与计算机连接起来。几千年来,先知、诗人与政治人物一直都在通过语言来操纵与重塑社会,而计算机现在也正在学习如何做到这一点。计算机并不需要派出杀手机器人来射杀人类,只要操纵人类扣动扳机就行。

自20世纪中叶迈入计算机时代以来,人类只要一想到计算机可能有多么强大,就似乎被某种恐惧所笼罩。然而几千年来,人类其实还一直被另一种更深层的恐惧所困扰。我们一直都知道故事与图像有着强大的力量,能够操控我们的心智,创造各种幻觉。于是自古以来,人类都害怕自己会陷入幻觉的世界。在古希腊,柏拉图讲过一则著名的洞穴寓言:一群人被锁链锁在洞穴里,一辈子都面对着一堵空白的墙壁,就像一个屏幕。在墙上,他们会看见各种物体投射在上面的影子,虽然那只是幻觉,但囚犯们觉得那就是现实。在古印度,佛教与印度教的圣贤都说,所有人都活在摩耶(maya,也就是幻觉的世界)当中。我们一般认为的现实往往只是自己脑海中的虚构。人类只因为相信了脑中这种或那种幻觉,就可能发动全面战争,杀害他人,也愿意献出自己的生命。在17世纪,笛卡儿就曾担心自己是被一个心怀不轨的恶魔困在幻觉世界,看到和听到的一切都只是恶魔的创造。目前这场计算机革命让我们必须直接面对柏拉图的洞穴、印度的摩耶,以及笛卡儿的恶魔。

刚刚读到的这些可能让你警觉,也可能让你愤怒。愤怒的对象可能是那些引领计算机革命的人,也可能是那些未能履行监督责任的政府。或者你愤怒的对象其实是我,觉得我是在扭曲事实、危言耸听,想让你误入歧途。但不论你怎么想,前文都可能对你造成一些情绪上的影响。也就是说,我讲了一个故事,而这个故事就可能改变你对某些事情的看法,甚至让你采取某些行动。但你怎么知道,究竟是谁创作了你刚刚读到的那个故事?

我在这里可以向你保证,这些文字都是我自己写的,我只是借助了一些其他人的帮助。我也向你保证,这些都是人类心智的文化产物。但你真的能够完全确定吗?在几年前确实可以,在21世纪20年代之前,讲到要创作复杂的文本,除了人类的心智,地球上确实没有其他事物能够做到。但今天情况不同了。从理论上来说,你刚才读到的段落也有可能是由某台高深莫测的智能机器生成的。

有什么影响?

随着计算机逐渐积累了更多力量,一个全新的信息网络很可能会出现。当然,这并不是说网络里的一切都是新的。至少在一段时间内,大多数旧的信息链还会被保留下来。而且,这个新的信息网络仍然会保留人与人的连接(比如家庭)以及人与文件的连接(比如教会)。然而,这个信息网络还会有越来越多的另外两种新型链条。

第一种是计算机与人类的连接,计算机在人类之间充当中介,有时候甚至会控制人类。脸书和TikTok就是两个我们耳熟能详的例子。这些计算机与人的连接不同于传统的人与文件的连接,因为计算机现在能够自行做出决策、创造想法,并深度伪造亲密关系,对人类发挥过去文件做不到的影响力。《圣经》虽然只是一份无声的文件,但它已经能对数十亿人产生深远的影响。现在想象一下,如果这样一本宗教经典不但能听会说,还能了解并不断塑造你最深的恐惧与希望,情况会怎样?

第二种是目前已经开始出现的计算机与计算机的链接,计算机能够彼此自行互动,人类被排除在这些链接之外,就连理解其中发生了什么都很困难。例如,谷歌大脑就尝试过用计算机来研发新的加密方法。当时的实验是要求两台计算机(代号为艾丽斯和鲍伯)必须交换加密信息,而第三台计算机伊夫则要试着去破解加密代码。如果伊夫能在一定时间内破解加密代码,就能得到分数;要是失败,则由艾丽斯和鲍伯得分。在经过大约15000次交流后,艾丽斯和鲍伯终于想出了一套伊夫无法破解的加密代码。这里的关键之处在于,进行这项实验的谷歌工程师并没有教给艾丽斯和鲍伯任何关于加密的知识,是那两台计算机完全自行创造出了专属于它们的私密语言。

像这样的事情也已经发生在实验室外的现实世界中了。以外汇市场为例,这是全球外汇交易的场域,也决定了各种货币(例如欧元与美元)之间的汇率。2022年4月,外汇市场的每日交易量平均为7.5万亿美元,其中有超过90%已经直接由计算机之间的对话完成。但究竟有多少人懂得外汇市场的运作方式呢?更不用说要了解一群计算机怎样在价值数万亿美元的交易上达成共识,又如何决定欧元与美元的价值了。

在可预见的未来,在这个全新的、以计算机为基础的网络里,虽然还是会包括我们这几十亿人类,但人类有可能在其中只是少数。因为除了人类,这个网络的成员还包括数十亿甚至数千亿个具备超智能且高深莫测的行为者。这样的网络将与人类历史甚至地球生命史上曾经存在的一切都截然不同。自大约40亿年前地球首次出现生命以来,所有信息网络都是生物(有机)网络。至于像教会与帝国这样的人类网络,也都是生物网络,与先前的其他生物网络(比如狼群)有许多相似之处,它们都围绕着掠食、繁殖、手足相争、浪漫三角恋这些传统生物戏剧展开。如果信息网络变成由非生物的计算机来主导,整个运作方式会相当不同,甚至超乎我们的想象。毕竟作为人类,我们就连想象力也是有机生化的产物,无法跳出原本设计的生物戏剧。

从第一台数字计算机问世至今已过去了80年,如今改变的步伐仍在不断加快,而且我们距离发挥计算机的全部潜力还相差很远。计算机还可能继续演化数百万年,而过去80年发生的事情与即将发生的事情相比简直微不足道。如果做一个粗略的比较,可以想象我们来到古代美索不达米亚的某个时间点,在这个时间点的80年前,才有人第一个想到用棍子在一块湿湿的黏土泥版上画上一些符号。在这一刻,我们难道能够想象未来会发展出亚历山大图书馆、《圣经》的力量或者苏联内务人民委员部的档案库?甚至这样的比较也大大低估了未来计算机发展的潜力。让我们再想象一下自己回到了早期地球(大约40亿年前)的某个时间点,在这个时间点的80年前,地球还是一片“有机汤”,并终于从中凝结出了第一个能够自我复制的遗传密码。在这个阶段,即使是单细胞的阿米巴原虫,其细胞组织、成千上万的内部细胞器以及控制运动及营养的能力,都还只是一种带着未来风格的幻想。在这个时间点,我们能够想象出未来会有霸王龙、亚马孙雨林,或是人类登上月球吗?

目前提到“计算机”,我们想到的仍然是个有屏幕、有键盘的金属盒子,因为这是我们的生物想象赋予20世纪最早那批计算机的形状。随着计算机不断成长与发展,它们正在摆脱旧的形态,采取全新的配置,打破人类的想象限制。不同于有机生物,计算机在一个时间点不一定只能出现在一个地方,而能够散布于整个空间,不同的组件位于不同的城市甚至大陆。就计算机的演化而言,从阿米巴原虫到霸王龙这样的改变,可能只需要10年。如果GPT-4还只是阿米巴原虫,未来的霸王龙会是什么样?生物演化花了40亿年,才从有机汤演化成能够登上月球的人类;计算机可能只需要几个世纪就能发展出超智能,超智能能够放大到整个行星大小,也能收缩到亚原子级别,抑或延伸跨越整个星系的时空。

从计算机术语的混乱程度也能看出计算机发展的速度有多快。几十年前,只要“计算机”一个词就能涵括所有概念,但现在的用词还包括了算法、机器人、自动化程序、人工智能、网络或云。光是“难以判断该用哪个词”这一点就已经很有意义了。生物包含了许多不同的个别实体,也能集合成“种”和“属”这样的分类。但如果讲到计算机,要判断某个实体到哪里结束,另一个实体又从哪里开始,以及如何准确地对它们进行分类,已经变得越来越困难。

在本书中,如果想指称有实体形式的软硬件复合体,我会用“计算机”这个词来称呼。之所以会选择听起来有点老掉牙的“计算机”一词,而不是“算法”或“人工智能”,一部分原因在于我知道这些术语变化得有多快,另一部分原因在于想提醒我们,目前的计算机革命仍然只涉及物理层面。计算机是由物质组成的,需要消耗能量,也会占据空间。计算机的制造与运行需要消耗大量的电力、燃料、水、土地、珍贵的矿物质与其他资源。目前仅各个数据中心就占了全球能源使用量的1%~1.5%;大型数据中心占地数百万平方英尺,每天需要几十万加仑的淡水来防止它们过热。

如果我想强调的是软件,本书使用的术语就应该是“算法”,但请别忘了,后续提到的所有算法都是需要在计算机上运行的。如果我使用“人工智能”这个术语,那么我想强调的是某些算法具备自我学习与改变的能力。从前面的讨论可以清楚地看到,我们或许该把人工智能(artificial intelligence,AI)视为“高深莫测的智能”(alien intelligence,AI)的缩写。随着人工智能的不断发展,它已经变得越来越不人工(也就是不依赖人类来设计),而变得越来越高深莫测,难以看透。还应该指出的是,大家在定义、评价人工智能的时候,常常会以“人类水平的智能”作为指标;对于人工智能什么时候才能达到这种水平,也是众说纷纭。但这项指标本身就十分让人困惑。这就像要定义、评价飞机的时候,用“鸟类飞行水平”作为指标一样。人工智能演化的目标并不是人类水准的智能,而是另一种完全不同类型的智能。

另一个会造成困惑的术语是“机器人”。本书如果说到“机器人”,指的是能在实体领域移动与操作的计算机;而“机器人程序”主要指的是在数字领域运行的算法。机器人程序可能会用假新闻污染你的社交媒体内容,而机器人则会帮你打扫客厅里的灰尘。

关于术语的最后一点是,对于以计算机为基础的“网络”,我倾向于单数而非复数的概念。我很清楚计算机能用来打造许多拥有不同特性的网络,而第十一章也讨论了世界可能被划分成许多完全不同甚至互相敌对的计算机网络。然而,即使是敌对的部落、王国与教会也会有些共同的重要特性,使得我们能够谈论目前主宰地球的单一人类网络到底有何特色,所以我更喜欢把计算机网络视为单一的概念,以便将其与那个它正在取代的人类网络进行对比。

承担责任

对于这个以计算机为基础的网络,我们虽然无法预测在几百或几千年之后它会有怎样的长期演变,但还是能谈谈目前的演变情况,而且这种对当下的讨论可能更为迫切,毕竟无论在政治还是个人层面,这个新计算机网络的兴起都会对所有人造成影响。在接下来的章节,我们会谈谈这个以计算机为基础的网络有何新颖之处,对人类生活又有何意义。我们开宗明义就该讲清楚的是,这个网络将会创造出全新的政治与个人现实。前面几章讨论的一大重点,在于信息并不等于真理与真相,而信息革命也并不会揭露事实真相。信息革命能做的是创造出新的政治结构、经济模式与文化规范。由于当前的信息革命的重要性远胜过往,所以它很可能会以前所未有的规模创造出前所未有的现实。

之所以有必要了解这一点,是因为目前的情况还在人类的掌控之中。虽然不知道还能持续多久,但目前人类仍有能力左右这些新的现实。为了能做出明智的决定,我们需要了解目前正在发生的事情。我们在编写计算机代码的时候,绝不只是在设计一个产品,而是在重新设计人类的政治、社会与文化,所以我们最好对政治、社会与文化都有一定的了解。而且我们做的决定,最后也必须由我们来负责。

但让人担心的是,就像脸书参与罗兴亚人的冲突一样,那些带领计算机革命的企业往往会把责任推给用户和选民,或者把责任推给政治人物或监管机构。当被指责制造社会与政治动乱时,它们会立刻丢出一堆借口,说:“我们只是一个平台。我们只是在提供用户想要的,而且选民也允许。我们没有逼迫任何人来用我们的服务,也没有违背任何现行的法律。要是用户不喜欢,怎么会继续用个不停?要是选民不喜欢,怎么没有通过法律来阻止我们?既然用户不断想要更多,也没有法律禁止我们的所作所为,那么一切都没问题。”

这样的论点不是太天真,就是太虚伪。脸书、亚马逊这些科技巨头,绝不只是像忠仆一样满足着用户的奇思妙想,遵循着政府的法规,而是正在越来越多地塑造着这些奇思妙想与法规。这些企业不但能直接联络到全球最强大的政府,还能投下巨额资金进行游说,以阻挠那些可能破坏其商业模式的法规。比如,它们曾经极力维护1996年《美国电信法》第230条,该条款规定线上平台无须对用户在平台发布的内容负责。正是这则条款让脸书无须在罗兴亚人冲突这件事上负责任。2022年,几家科技巨头在美国的游说费用接近7000万美元,在欧盟各国的游说费用更是高达1.13亿欧元,比石油与天然气公司及制药公司的游说费用还高。各大科技巨头也能直接影响民众的情感系统,而且它们还是操控用户与选民想法的大师。如果说这些企业都听从选民与用户的意愿,但它们同时也能塑造选民与用户的意愿,那么究竟是谁控制了谁?

这里的问题其实更严重。我们过去认为“顾客永远是对的”“选民能做出最好的选择”,但这些原则的前提是假设顾客、选民与政治人物都很清楚自己身边发生了什么。他们假设,选择使用TikTok与Instagram(照片墙)的用户都完全了解这个选择的全部后果,也认为负责监管苹果等公司的选民及政治人物完全了解这些公司的商业模式与活动。他们假设大家都真正了解这个新信息网络的详情与细节,并真心送上自己的祝福。

但事实上,我们根本没那么了解。这不是因为我们太愚蠢,而是因为科技太复杂,而且发展的速度太过惊人。我们得耗费大量心思才能搞懂类似“以区块链为基础的加密货币”这种东西,而且当你觉得自己懂了,事情已经又有了变化。在这里,金融是个格外重要的例子,原因有二。第一,现代金融工具完全由信息组成,所以比起创造实物对象,计算机创造或改变金融工具实在太容易了。过去讲到货币、股票和债券,它们都是由黄金或纸张制成的实物对象,但今天它们已经成为主要存在于数据库中的数字实体。第二,这些数字实体对社会与政治世界的影响重大。如果人类不再能够理解金融体系究竟如何运作,那么对民主制度(或独裁制度)又会有什么影响?

举例来说,我们可以思考一下这项新科技可能如何影响税收。传统上,个人与企业只需要在自己实际所在的国家纳税。但当实体空间慢慢被网络空间增强或取代时,当越来越多的交易只是信息的传输,而不是实体商品或传统货币的交换时,事情就变得没那么好判断了。比如,某位乌拉圭公民可能每天在网络上与许多企业互动,这些企业不见得都在乌拉圭有实体公司,但都是在为他提供各种服务,如谷歌为他提供免费的搜索,字节跳动为他提供免费的社交媒体。还有其他一些外国企业常常向他投放广告:耐克想卖给他鞋子,标致想卖给他汽车,可口可乐则想卖给他饮料。为了锁定他,这些企业还会向谷歌与字节跳动购买关于他的个人信息与广告空间。此外,谷歌与字节跳动也会运用从他和数百万其他用户那里收集到的信息,研发出强大的新型人工智能工具,再把这些工具卖给世界各地的政府与企业。正是因为这样的交易,让谷歌与字节跳动跻身全球数一数二富有的企业。那么,关于他的这些交易应该在乌拉圭被课税吗?

有些人认为确实应该被课税。不只是因为这些来自乌拉圭的信息让这些企业赚到了钱,更是因为这些活动其实伤害了在乌拉圭纳税的企业。当地报纸、电视台与电影院,会被这些企业抢走顾客与广告收益。而且乌拉圭未来的人工智能公司处境也会非常艰辛,无法和谷歌与字节跳动庞大的数据库竞争。然而这些科技巨头会说,这些交易既没有通过任何在乌拉圭的实体,也没有任何货币交易。谷歌与字节跳动只是为乌拉圭公民提供了免费的网络服务,而作为交换,公民自愿提供了他们的购物记录、度假照片、可爱的猫咪视频与其他信息。

如果各国政府还是想对这些交易课税,就需要重新思考一些最基本的概念,比如“链接性”(nexus)。在税务规定上,“链接性”指的是个别实体与特定司法管辖区之间的链接。传统上,要判断某个企业是否与某个特定国家有链接性,就要看该企业在该国是否有实体存在,例如设有办公室、研究中心或实体店面等。想要解决计算机网络造成的税收难题,一种方法就是重新定义链接性。经济学家马尔科·科腾伯格就说:“目前对链接性的定义是基于在一国的实体存在,这有必要改变,我们应引入数字存在的概念。”也就是说,即使谷歌与字节跳动在乌拉圭并没有实体存在,但基于乌拉圭人会使用其线上服务这一事实,也必须在乌拉圭纳税。壳牌与英国石油公司只要在某国开采石油,就会向该国纳税;同理,科技企业也该向它们采集信息数据的国家纳税。

但这仍然有个问题尚未解决:乌拉圭政府到底该对什么征税?举例来说,假设乌拉圭公民用TikTok分享了100万个猫咪视频。字节跳动并没有向他们收钱,也没有为此支付任何费用。但字节跳动后来用这些视频训练了一个图像识别人工智能,并以1000万美元的价格卖给南非政府。乌拉圭政府怎么才能知道这笔钱有一部分是来自乌拉圭的猫咪视频?又该怎么计算比例?乌拉圭该收“猫咪视频税”吗?(虽然这可能听起来像个笑话,但我们会在第十一章看到,其实在人工智能最重要的一项突破上,猫咪视频真的很关键。)

事情甚至还没这么简单。假设乌拉圭政界开始推动一个新计划,准备对数字交易征税。此时某家科技巨头找到某位政治人物,表示能够向他提供关于乌拉圭选民的宝贵信息,并且对自己旗下的社交媒体与搜索算法进行微调,以巧妙的方式支持他,帮助他在下一次选举胜出。作为交换,这位政客很可能放弃推动数字税的计划,甚至可以制定一些法规,保护这家科技企业不会因为用户隐私问题被告上法庭,从而使它更容易在乌拉圭获取各种用户信息。这算是行贿吗?请注意,这里可没有任何美元或乌拉圭比索的交易。

这种以信息换信息的交易已经无所不在。目前,每天都有数十亿人与科技巨头进行大量交易,但因为几乎没有任何金钱流动,也就无法从银行账户中看出端倪。我们从科技巨头那里得到信息,而我们付出的代价也是信息。随着越来越多的交易采用以信息换信息的模式,信息经济的成长其实是以牺牲货币经济为代价的,最后可能连货币的概念都会动摇。

货币应该是一种被普遍采用的价值标准,而不是只适用于部分情境的价值象征。随着越来越多的东西的价值以信息来衡量,而从货币来看却都是“免费”的,在某种程度上,如果还是只看个人或企业拥有多少美元或比索来判断他们是否富有,是无法反映现实的。如果一个人或一家企业在银行里没什么钱,但拥有庞大的数据库,这个人或这家企业有可能才是该国最富有或最强大的实体。虽然理论上也可以用货币来量化这些信息的价值,但并不需要真的把这些信息换成美元或比索。既然只用信息就能换到他们想要的东西,为什么还需要美元呢?

这对税收有着深远的影响。国家征税的目的是进行财富再分配,从最富有的个人与企业那里取得部分财富,用来为所有人提供服务。然而,因为有许多交易很快就不会再涉及货币,如果税收制度仍然只对货币征税,那么很快就会跟不上时代。在以数据为基础的经济中,价值的存储是通过数据的形式,而非货币的形式,所以如果只对货币征税,在经济上与政治上都会是种扭曲。一国实际上最富有的实体可能不用缴税,只因为它们的财富是由许多PB(拍字节)级数据组成的,而不是数十亿的美元。

说到对货币征税,国家已经积累了几千年的经验。但说到对信息征税,至少到目前,各国仍然一筹莫展。如果人类真的从一个以货币交易为主的经济转向以信息交易为主的经济,各国该如何应对?社会信用体系或许是国家适应新局面的一种方式。我们会在第七章谈到,社会信用体系本质上就是一种新型货币——一种以信息为基础的货币。所有国家都应该打造自己的社会信用货币吗?有没有其他策略?

右翼与左翼

税收只是计算机革命造成的诸多问题之一。这个计算机网络正在打乱几乎所有的权力结构。民主制度担心会崛起新的数字独裁,独裁制度担心会出现不知该如何控制的行为者,而所有人都该担心未来将会失去隐私,数据殖民主义即将蔓延。我们会在下面几章一一解释这些威胁的含义,但这里的重点在于:关于这些威胁的讨论才刚刚开始,但科技的发展却远远快于政策的发展。

举例来说,共和党与民主党在人工智能政策上有什么不同吗?在人工智能问题上,右翼的立场是什么?左翼的立场又是什么?如果是保守派,究竟会因为人工智能威胁到传统以人为中心的文化,于是反对人工智能,还是会因为人工智能既能推动经济增长,又能减少对移民工人的需求,于是支持人工智能?如果是进步派,究竟会因为虚假信息的风险与偏见的增加而反对人工智能,还是会因为人工智能是一种创富手段,能够提供资金创造全面福利国家而支持人工智能?结果实在难料,因为直到最近,共和党、民主党以及全世界大多数政党,都还没有思考或谈论过这些问题。

比起政治人物与选民,有些人(比如高科技公司的工程师与高管)更了解人工智能、加密货币和社会信用之类的新科技的发展。但遗憾的是,这些人多半并未运用他们的知识来协助约束这些新科技的爆炸性潜力,而是用它们赚取了数十亿美元,或是累积了大量PB级的数据。这会导致危险的信息不对称:那些领导信息革命的人,比起那些应该监管它的人更了解背后的技术。在这种情况下,只是一直高喊“顾客永远是对的”“选民能做出最好的选择”又有什么意义呢?

接下来的章节希望能稍微改善一下这种信息不对称的情形,并鼓励我们对这场计算机革命创造的新现实负起责任。以下章节会讨论不少技术,但观点完全是从人性出发的。这里的关键问题是:对人类来说,活在一个新的、以计算机为基础的网络里,人类可能成为越来越没有权力的少数群体,这意味着什么?这个新网络将会怎样改变人类的政治、社会、经济与日常生活?如果人类被数十亿个非人类实体持续监控、指导、激励或制裁,会是什么感觉?在这种让人震惊的新世界中,人类必须做出怎样的改变才能适应、生存,甚至过得意气风发?

别相信决定论

这里最重要的一点就是,科技的发展很少是确定的。如果相信了科技决定论,觉得没有别的可能,也就等于让人类再也不用负责,而这会十分危险。没错,人类社会也是由各种信息网络组成的,而发明新的信息技术就必然会改变社会。比如,人类发明印刷术、发明机器学习算法,都必然会引发深远的社会与政治革命。但人类对于这种革命的速度、形式与方向仍然有极大的控制权,也意味着我们应该负起很大的责任。

在任何特定时刻,我们的科学知识与技术技能都能用来研发许多不同的技术,但人类手上的资源有限,对于投资的方向应该做出负责任的选择。这些资源究竟该用来研发新的疟疾药物、新的风力涡轮机,还是新的沉浸式视频游戏?没有哪个选项是必然的,每个选项都反映了背后的政治、经济与文化优先级。

在20世纪70年代,多数计算机公司(比如IBM)都把注意力放在研发大型且昂贵的机器上,并将其出售给大企业与政府机构。虽然技术上也可以研发小型、便宜的个人计算机,并出售给个人顾客,但IBM就是对这项业务没什么兴趣,觉得这与IBM的商业模式不相符。苏联对计算机也十分感兴趣,但他们比IBM更没有意愿研发个人计算机。毕竟在一个连私人拥有打字机都成问题的国家,让私人控制强大的信息技术,完全是想都不该想的事情。所以,计算机主要是提供给苏联的工厂经理使用,而且他们也得将所有数据传回莫斯科进行分析。结果就是莫斯科被大量的文书工作淹没。到20世纪80年代,这套笨重的计算机系统每年会产出8000亿份文件,全部要送往莫斯科。

然而,在IBM与苏联政府放弃研发个人计算机的时候,加利福尼亚家酿计算机俱乐部(California Homebrew Computer Club)的成员决定自己研发。这是一个有意识的意识形态方面的决定,受到20世纪60年代反主流文化的影响,其思想包括无政府主义追求的“权力回归人民”的主张,以及自由主义对政府与大企业的不信任。

家酿计算机俱乐部的主要成员包括史蒂夫·乔布斯与斯蒂夫·沃兹尼亚克,他们梦想远大,但口袋里没钱,而且得不到美国企业或政府机构的资源。为了研发出第一台苹果计算机,乔布斯和沃兹尼亚克变卖了他们的个人财产,比如乔布斯的大众汽车。正是因为这样的个人决定,而不是什么科技女神神圣而必然的旨意,到1977年,个人顾客才能以1298美元的价格买到一台第二代苹果计算机。虽然这不是一笔小钱,但中产阶层还能买得起。

我们不难想象可能会有另一种历史。假设20世纪70年代的人拥有一样的科学知识与技术技能,但麦卡锡主义扼杀了20世纪60年代的反主流文化,建立了一个美国版极权政权,那么,我们今天会有个人计算机吗?当然,个人计算机仍然可能在另一个时空背景下研发出来。但在历史上,时空环境至为重要,没有哪两个时刻是一样的。美洲在15世纪90年代被西班牙殖民,而不是在16世纪20年代被奥斯曼帝国殖民;原子弹是由美国在1945年研发成功的,而不是由德国在1942年研发成功的,这些差异在历史上都非常重要。同样,如果个人计算机不是出现在20世纪70年代的旧金山,而是出现在80年代的大阪或是21世纪初的上海,在政治、经济与文化上将会对这些地区造成极大的差异。

目前正在研发的新技术也是如此。工程师可能为专制的政府或无情的企业研发新工具,让它们每天24小时监控公民与客户,使权力进一步集中。黑客也可能为民主政体研发新工具,让它们得以揭露政府的腐败与企业的不当行为,使社会的自我修正机制得以加强。这两类技术都有研发的可能。

选择还不止于此。即使已经研发出了特定工具,也可以有各种不同的用途。一把刀,可以用来杀人、做手术救人,也可以用来切菜做晚餐。并不是那把刀在逼我们的手做这些事,而是出于人类的选择。同样,当初发明了便宜的收音机之后,德国几乎每个家庭都买得起一台。但收音机有什么用途呢?有了便宜的收音机,意味着代表极权领导的演说能够直接传进每个德国家庭的客厅,也意味着每个德国家庭都能选择收听不同的广播节目,反映并培养出多样化的政治与艺术观点。民主德国走了其中一条路,联邦德国则走了另一条。虽然技术都一样,但不同的政体对技术的使用却完全不同。

21世纪的新技术也是如此。想要发挥我们的能动性,就得先了解这些新技术的本质与能力,这对每位公民来说都是急迫而应负的责任。当然,并不是说每个人都得去拿个计算机科学博士学位,但如果希望未来还在我们的掌握之中,就确实需要好好了解计算机对政治的影响。在接下来的几章,我们会为21世纪的公民提供这种计算机政治的概览介绍。我们会先了解这个新的计算机网络会为政治带来怎样的威胁与承诺,然后探讨民主政体、独裁政体与整个国际体系有哪些不同的方式来适应这种新的计算机政治。

政治需要在真相与秩序之间达成微妙的平衡。随着计算机成为整个信息网络里的重要成员,它们也承担着越来越多的找寻真相、维护秩序的任务。比如,如果要找寻气候变化的真相,现在越来越多的运算都必须依赖计算机,而如果要在气候变化议题上达成社会共识,也必须依赖推荐算法来管理新闻的推送,并依靠创意算法写出新闻故事、虚假新闻和虚构的故事。人类目前之所以在气候变化议题上陷入政治僵局,部分原因在于计算机也陷入了僵局。有一组计算机跑出的结果警告我们有一场生态灾难即将发生,但另一组计算机则叫我们去看一些质疑此类警告的视频。我们该相信哪一组计算机?人类政治现在也成了计算机政治。

想要理解新的计算机政治,就得更深入理解计算机有什么真正“新”的地方。我们在本章中已经提过,不同于印刷机或其他先前的工具,计算机能够自己做出决策、自己创造想法,但这只是冰山一角。计算机真正“新”的地方在于它们做出决策与创造想法的方式。如果计算机做出决策与创造想法的方式与人类相似,计算机只会成为一种“新人类”。科幻小说常常出现这样的场景:计算机变得有了意识、有了感情,爱上了人类,最后发现自己和人类并无不同。然而现实完全不是这样,而且可能更让人担忧。

1、Alan Turing, “Intelligent Machinery,” in The Essential Turing, ed. B. Jack Copeland (New York: Oxford University Press, 2004), 395–432.

2、Alan Turing, “Computing Machinery and Intelligence,”Mind 59, no. 236 (1950): 433–60.

3、Alexis Madrigal, “How Checkers Was Solved,”Atlantic , July 19, 2017, www.theatlantic.com/technology/archive/2017/07/marion-tinsley-checkers/534111/.

4、Richard Rhodes,The Making of the Atomic Bomb(New York:Simon & Schuster,1986),711.

5、Levin Brinkmann et al., “Machine Culture,”Nature Human Behavior 7 (2023): 1855–68.

6、Max Fisher, The Chaos Machine: The Inside Story of How Social Media Rewired Our Minds and Our World (New York: Little, Brown, 2022).

7、之后的论述来源于以下文献:Thant Myint-U, The Hidden History of Burma: Race, Capitalism,and the Crisis of Democracy in the 21st Century (New York: W. W. Norton, 2020);Habiburahman, First, They Erased Our Name: A Rohingya Speaks, with Sophie Ansel(London: Scribe, 2019); Christina Fink, “Dangerous Speech, Anti-Muslim Violence, and Facebook in Myanmar,”Journal of International Affairs 71, no. 1.5 (2018): 43–52; Naved Bakali, “Islamophobia in Myanmar: The Rohingya Genocide and the ‘War on Terror,’”Race and Class 62, no. 4 (2021): 1–19; Ali Siddiquee, “The Portrayal of the Rohingya Genocide and Refugee Crisis in the Age of Post-truth Politics,”Asian Journal of Comparative Politics 5, no. 2 (2019): 89–103; Neriah Yue, “The ‘Weaponization’ of Facebook in Myanmar: A Case for Corporate Criminal Liability,”Hastings Law Journal 71, no. 3(2020): 813–44; Jennifer Whitten-Woodring et al., “Poison if You Don’t Know How to Use It: Facebook, Democracy, and Human Rights in Myanmar,”International Journal of Press/Politics 25, no. 3 (2020): 1–19.

8、参见:Thant,“Unfinished Nation,” in Hidden History of Burma.也请参见:Anthony Ware and Costas Laoutides, Myanmar’s “Rohingya” Conflict (New York: Oxford University Press, 2018), 14–53.

9、Thant, Hidden History of Burma; Ware and Laoutides, Myanmar’s “Rohingya” Conflict, 6;Anthony Ware and Costas Laoutides, “Myanmar’s ‘Rohingya’ Conflict: Misconceptions and Complexity,”Asian Affairs 50, no. 1 (2019): 60–79; UNHCR, “Bangladesh Rohingya Emergency,” accessed Feb. 13, 2024, www.unhcr.org/ph/campaigns/rohingya-emergency;Mohshin Habib et al., Forced Migration of Rohingya: The Untold Experience (Ontario:Ontario International Development Agency, 2018), 69; Annekathryn Goodman and Iftkher Mahmood, “The Rohingya Refugee Crisis of Bangladesh: Gender Based Violence and the Humanitarian Response,”Open Journal of Political Science 9, no. 3 (2019): 490–501.

10、Thant, Hidden History of Burma, 165.

11、Amnesty International, Social Atrocity, 45.

12、Thant, Hidden History of Burma, 166.

13、Amnesty International, Social Atrocity, 7.

14、Tom Miles, “U.N. Investigators Cite Facebook Role in Myanmar Crisis,” Reuters,March 13, 2018, www.reuters.com/article/idUSKCN1GO2Q4/.

15、Amnesty International, Social Atrocity, 8.

16、John Clifford Holt, Myanmar’s Buddhist-Muslim Crisis: Rohingya, Arakanese, and Burmese Narratives of Siege and Fear (Honolulu: University of Hawaii Press, 2019), 241–43; Kyaw Phone Kyaw, “The Healing of Meiktila,”Frontier Myanmar, April 21, 2016, www.frontiermyanmar.net/en/the-healing-of-meiktila/.

17、关于各种推荐算法的文化力量,请参见:Brinkmann et al.,“Machine Culture”; Jessica Su, Aneesh Sharma, and Sharad Goel, “The Effect of Recommendations on Network Structure,” in Proceedings of the 25th International Conference on World Wide Web (Geneva:International World Wide Web Conferences Steering Committee, 2016), 1157–67; Zhepeng Li, Xiao Fang, and Olivia R. Liu Sheng, “A Survey of Link Recommendation for Social Networks: Methods, Theoretical Foundations, and Future Research Directions,”ACM Transactions on Management Information Systems 9, no. 1 (2018): 1–26.

18、Amnesty International, Social Atrocity, 47.

19、Ibid., 46.

20、Ibid.,38–49.也请参见:Zeynep Tufekci,“Algorithmic Harms Beyond Facebook and Google:Emergent Challenges of Computational Agency,”Colorado Technology Law Journal 13(2015): 203–18; Janna Anderson and Lee Rainie, “The Future of Truth and Misinformation Online,” Pew Research Center, Oct. 19, 2017, www.pewresearch.org/internet/2017/10/19/the-future-of-truth-and-misinformation-online/; Ro’ee Levy, “Social Media, News Consumption, and Polarization: Evidence from a Field Experiment,”American Economic Review 111, no. 3 (2021): 831–70; William J. Brady, Ana P. Gantman, and Jay J. Van Bavel,“Attentional Capture Helps Explain Why Moral and Emotional Content Go Viral,”Journal of Experimental Psychology: General 149, no. 4 (2020): 746–56.

21、Yue Zhang et al., “Siren’s Song in the AI Ocean: A Survey on Hallucination in Large Language Models” (preprint, submitted in 2023), arxiv.org/abs/2309.01219; Jordan Pearson,“Researchers Demonstrate AI ‘Supply Chain’ Disinfo Attack with ‘PoisonGPT,’”Vice ,July 13, 2023, www.vice.com/en/article/xgwgn4/researchers-demonstrate-ai-supply-chain-disinfo-attack-with-poisongpt.

22、František Baluška and Michael Levin, “On Having No Head: Cognition Throughout Biological Systems,”Frontiers in Psychology 7 (2016), article 902.

23、关于人类的意识与决策,更为深入的讨论请参见:Mark Solms,The Hidden Spring: A Journey to the Source of Consciousness(London:Profile Books,2021).

24、关于人类与人工智能的意识与智能的深入讨论请参见尤瓦尔·赫拉利的《未来简史》的第3章、《今日简史》的第3章等文献:Yuval Noah Harari,Homo Deus(New York:Harper,2017),chaps.3,10; Yuval Noah Harari, 21 Lessons for the 21st Century (New York: Spiegel & Grau, 2018), chap. 3; Yuval Noah Harari, “The Politics of Consciousness,”in Aviva Berkovich-Ohana et al. (eds.), Perspectives On Consciousness: The Role Of Subjective Experience (Cambridge (Mass.): MIT Press, 2025 [forthcoming]); Patrick Butlin et al., “Consciousness in Artificial Intelligence: Insights from the Science of Consciousness”(preprint, submitted in 2023), arxiv.org/abs/2308.08708.

25、GPT-4系统卡并不是一个具体的、物理存在的卡片,而是一个用于描述GPT-4模型特性、功能、安全挑战以及OpenAI为准备其部署而采取的安全措施的文档或概述,其内容会随着时间和技术的进步而不断更新。——编者注

26、OpenAI, “GPT-4System Card,” March 23, 2023, 14, cdn.openai.com/papers/gpt-4-system-card.pdf.

27、Ibid., 15–16.

28、参见尤瓦尔·赫拉利《未来简史》第3章等文献:Harari, Homo Deus, chaps. 3, 10; Harari,“The Politics of Consciousness”.

29、现实生活中的案例请参见:Jamie Condliffe,“Algorithms Probably Caused a Flash Crash of the British Pound,”MIT Technology Review,Oct. 7,2016,www.technologyreview.com/2016/10/07/244656/algorithms-probably-caused-a-flash-crash-of-the-british-pound/; Bruce Lee, “Fake Eli Lilly Twitter Account Claims Insulin Is Free, Stock Falls 4.37%,” Forbes, Nov. 12, 2022, www.forbes.com/sites/brucelee/2022/11/12/fake-eli-lilly-twitter account-claims-insulin-is-free-stock-falls-43/?sh=61308fb541a3.

30、Jenna Greene, “Will ChatGPT Make Lawyers Obsolete? (Hint: Be Afraid),” Reuters,Dec. 10, 2022, www.reuters.com/legal/transactional/will-chatgpt-make-lawyers-obsoletehint-be-afraid-2022-12-09/; Chloe Xiang, “ChatGPT Can Do a Corporate Lobbyist’s Job, Study Determines,”Vice , Jan. 5, 2023, www.vice.com/en/article/3admm8/chatgpt can-do-a-corporate-lobbyists-job-study-determines; Jules Ioannidis et al., “Gracenote.ai: Legal Generative AI for Regulatory Compliance,” SSRN, June 19, 2023, ssrn.com/abstract=4494272; Damien Charlotin, “Large Language Models and the Future of Law,”SSRN, Aug. 22, 2023, ssrn.com/abstract=4548258; Daniel Martin Katz et al., “GPT-4Passes the Bar Exam,” SSRN, March 15, 2023, ssrn.com/abstract=4389233. Though see also Eric Martínez, “Re-evaluating GPT-4’s Bar Exam Performance,” SSRN, May 8, 2023, ssrn.com/abstract=4441311.

31、Brinkmann et al., “Machine Culture.”

32、Julia Carrie Wong, “Facebook Restricts More Than 10,000 QAnon and US Militia Groups,”Guardian, Aug. 19, 2020, www.theguardian.com/us-news/2020/aug/19/facebook-qanon-us militia-groups-restrictions.

33、“FBI Chief Says Five QAnon Conspiracy Advocates Arrested for Jan 6 U.S. Capitol Attack,”Reuters, April 15, 2021, www.reuters.com/world/us/fbi-chief-says-five-qanon-conspiracy advocates-arrested-jan-6-us-capitol-attack-2021-04-14/.

34、“Canadian Man Faces Weapons Charges in Attack on PM Trudeau’s Home,” Al Jazeera,July 7, 2020, www.aljazeera.com/news/2020/7/7/canadian-man-faces-weapons-charges-in attack-on-pm-trudeaus-home. 也请参见:Mack Lamoureux,“A Fringe Far-Right Group Keeps Trying to Citizen Arrest Justin Trudeau,”Vice , July 28, 2020, www.vice.com/en/article/dyzwpy/a-fringe-far-right-group-keeps-trying-to-citizen-arrest-justin-trudeau.

35、“Rémy Daillet: Conspiracist Charged over Alleged French Coup Plot,” BBC, Oct. 28, 2021,www.bbc.com/news/world-europe-59075902; “Rémy Daillet: Far-Right ‘Coup Plot’ in France Enlisted Army Officers,”Times, Oct. 28, 2021, www.thetimes.co.uk/article/remy daillet-far-right-coup-plot-france-army-officers-qanon-ds22j6g05.

36、Mia Bloom and Sophia Moskalenko, Pastels and Pedophiles: Inside the Mind of QAnon(Stanford, Calif.: Stanford University Press, 2021), 2.

37、John Bowden, “QAnon-Promoter Marjorie Taylor Greene Endorses Kelly Loeffler in Georgia Senate Bid,”Hill, Oct. 15, 2020, thehill.com/homenews/campaign/521196-qanon-promoter marjorie-taylor-greene-endorses-kelly-loeffler-in-ga-senate/.

38、Camila Domonoske, “QAnon Supporter Who Made Bigoted Videos Wins Ga. Primary, Likely Heading to Congress,” NPR, Aug. 12, 2020, www.npr.org/2020/08/12/901628541/qanon supporter-who-made-bigoted-videos-wins-ga-primary-likely-heading-to-congre.

39、Nitasha Tiku, “The Google Engineer Who Thinks the Company’s AI Has Come to Life,”Washington Post, June 11, 2022, www.washingtonpost.com/technology/2022/06/11/google ai-lamda-blake-lemoine/.

40、Matthew Weaver, “AI Chatbot ‘Encouraged’ Man Who Planned to Kill Queen, Court Told,”Guardian, July 6, 2023, www.theguardian.com/uk-news/2023/jul/06/ai-chatbot-encouraged man-who-planned-to-kill-queen-court-told; PA Media, Rachel Hall, and Nadeem Badshah,“Man Who Broke into Windsor Castle with Crossbow to Kill Queen Jailed for Nine Years,”Guardian, Oct. 5, 2023, www.theguardian.com/uk-news/2023/oct/05/man-who-broke-into windsor-castle-with-crossbow-to-kill-queen-jailed-for-nine-years; William Hague, “The Real Threat of AI Is Fostering Extremism,”Times, Oct. 30, 2023, www.thetimes.co.uk/article/the real-threat-of-ai-is-fostering-extremism-jn3cw9rd3.

41、Marcus du Sautoy, The Creativity Code: Art and Innovation in the Age of AI (Cambridge,Mass.: Belknap Press of Harvard University Press, 2019); Brinkmann et al., “Machine Culture.”

42、Martin Abadi and David G. Andersen, “Learning to Protect Communications with Adversarial Neural Cryptography,” Oct. 21, 2016, arXiv, arXiv.1610.06918.

43、Robert Kissell, Algorithmic Trading Methods: Applications Using Advanced Statistics, Optimization, and Machine Learning Technique (London: Academic Press, 2021); Anna Louise Jackson, “A Basic Guide to Forex Trading,”Forbes, March 17, 2023, www.forbes.com/adviser/investing/what-is-forex-trading/; Bank of International Settlements, “Triennial Central Bank Survey: OTC Foreign Exchange Turnover in April 2022,” Oct. 27, 2022, www.bis.org/statistics/rpfx22_fx.pdf.

44、Jaime Sevilla et al., “Compute Trends Across Three Eras of Machine Learning,”2022 International Joint Conference on Neural Networks (IJCNN), IEEE, Sept. 30, 2022,doi.10.1109/IJCNN55064.2022.9891914; Bengio et al., “Managing AI Risks in an Era of Rapid Progress.”

45、Kwang W. Jeon, The Biology of Amoeba (London: Academic Press, 1973).

46、1平方英尺约等于0.093平方米。——编者注

47、1加仑约等于4.546升。——编者注

48、International Energy Agency, “Data Centers and Data Transmission Networks,” last update July 11, 2023, accessed Dec. 27, 2023, www.iea.org/energy-system/buildings/data-centers and-data-transmission-networks; Jacob Roundy, “Assess the Environmental Impact of Data Centers,” TechTarget, July 12, 2023, www.techtarget.com/searchdatacenter/feature/Assess the-environmental-impact-of-data-centers; Alex de Vries, “The Growing Energy Footprint of Artificial Intelligence,”Joule 7, no. 10 (2023): 2191–94, doi.org/10.1016/j.joule.2023.09.004;Javier Felipe Andreu, Alicia Valero Delgado, and Jorge Torrubia Torralba, “Big Data on a Dead Planet: The Digital Transition’s Neglected Environmental Impacts,” The Left in the European Parliament, Nov. 15, 2022, left.eu/issues/publications/big-data-on-a-dead-planet the-digital-transitions-neglected-environmental-impacts/.关于对水源的要求,参见:Shannon Osaka,“A New Front in the Water Wars:Your Internet Use,”Washington Post,April 25,2023,www.washingtonpost.com/climate-environment/2023/04/25/data-centers drought-water-use/.

49、Shoshana Zuboff, The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power (New York: PublicAffairs, 2018); Mejias and Couldry, Data Grab;Brian Huseman (Amazon vice president) to Chris Coons (U.S. senator), June 28, 2019,www.coons.senate.gov/imo/media/doc/Amazon%20Senator%20Coons__Response%20 Letter__6.28.19%5B3%5D.pdf.

50、“Tech Companies Spend More Than € 100 Million a Year on EU Digital Lobbying,”Euronews, Sept. 11, 2023, www.euronews.com/my-europe/2023/09/11/tech-companies spend-more-than-100-million-a-year-on-eu-digital-lobbying; Emily Birnbaum, “Tech Giants Broke Their Spending Records on Lobbying Last Year,” Bloomberg, Feb. 1, 2023, www.bloomberg.com/news/articles/2023-02-01/amazon-apple-microsoft-report-record-lobbying spending-in-2022.

51、Marko Köthenbürger, “Taxation of Digital Platforms,” in Tax by Design for the Netherlands,ed. Sijbren Cnossen and Bas Jacobs (New York: Oxford University Press, 2022), 178.

52、Omri Marian, “Taxing Data,”BYU Law Review 47 (2021); Viktor Mayer-Schönberger and Thomas Ramge, Reinventing Capitalism in the Age of Big Data (New York: Basic Books, 2018); Jathan Sadowski, Too Smart: How Digital Capitalism Is Extracting Data,Controlling Our Lives, and Taking Over the World (Cambridge, Mass.: MIT Press, 2020);Douglas Laney, “Unlock Tangible Benefits by Valuing Intangible Data Assets,”Forbes,March 9, 2023, www.forbes.com/sites/douglaslaney/2023/03/09/unlock-tangible-benefits by-valuing-intangible-data-assets/?sh=47f6750b1152; Ziva Rubinstein, “Taxing Big Data:A Proposal to Benefit Society for the Use of Private Information,”Fordham Intellectual Property, Media, and Entertainment Law 31, no. 4 (2021): 1199, ir.lawnet.fordham.edu/iplj/vol31/iss4/6; M. Fleckenstein, A. Obaidi, and N. Tryfona, “A Review of Data Valuation Approaches and Building and Scoring a Data Valuation Model,”Harvard Data Science Review 5, no. 1 ( 2023), doi.org/10.1162/99608f92.c18db966.

53、Yasmann, “Grappling with the Computer Revolution”; James L. Hoot, “Computing in the Soviet Union,”Computing Teacher, May 1987; William H. Luers, “The U.S. and Eastern Europe,”Foreign Affairs 65, no. 5 (Summer 1987): 989–90; Slava Gerovitch, “How the Computer Got Its Revenge on the Soviet Union,”Nautilus, April 2, 2015, nautil.us/how the-computer-got-its-revenge-on-the-soviet-union-235368/; Benjamin Peters, “The Soviet InterNyet,”Eon, Oct. 17, 2016, eon.co/essays/how-the-soviets-invented-the-internet-and why-it-didnt-work; Benjamin Peters, How Not to Network a Nation: The Uneasy History of the Soviet Internet (Cambridge, Mass.: MIT Press, 2016).

54、Fred Turner, From Counterculture to Cyberculture: Stewart Brand, the Whole Earth Network,and the Rise of Digital Utopianism (Chicago: University of Chicago Press, 2010).

55、Paul Freiberger and Michael Swaine, Fire in the Valley: The Making of the Personal Computer, 2nd ed. (New York: McGraw Hill, 2000), 263–65; Laine Nooney, The Apple II Age: How the Computer Became Personal (Chicago: University of Chicago Press, 2023), 57.